云主机搭建vpn服务器 英伟达靠CUDA锁死算力,开发者被迫绑定,生态成铁链 2006年的时候,英伟达公司推出了一个叫CUDA的技术,它不是新的芯片,也不是新的算法,而是让图形处···

云主机搭建vpn服务器

英伟达靠CUDA锁死算力,开发者被迫绑定,生态成铁链

2006年的时候,英伟达公司推出了一个叫CUDA的技术,它不是新的芯片,也不是新的算法,而是让图形处理器做中央处理器的工作,以前图形处理器只负责玩游戏和渲染图像,现在它能与中央处理器一起运行程序,特别是那些需要同时计算大量数据的任务,这一步很关键,相当于改变了电脑的大脑结构。

那时候编写并行计算代码特别困难,需要掌握图形编程技术,例如OpenGL或Direct3D,普通人根本没法轻易上手,后来CUDA出现后,人们就能直接用C语言来写代码,学过编程的人可以很快学会使用,接着它还支持Fortran、C++、Python这些语言,科研人员和工程师都开始广泛采用,这不只是技术上的进步,更是降低了参与门槛,让更多人能够加入进来。

英伟达接着这个机会,在2008年推出了Tesla系列显卡,还搭配了CUDA一起销售,企业买这些卡不只是为了玩游戏或者搞设计,而是想把它当成计算机器来用,服务器里装上几块Tesla卡,就能执行超级计算级别的任务,这个做法很厉害,等于绕过了传统的CPU厂商,自己重新建立了一套计算体系。

更厉害的是,CUDA不只是个工具,它是一整套东西,从编译器到库文件,再到调试工具和社区论坛,全都给你准备好,你一旦用上CUDA,代码、经验、习惯就都绑在这上面,想换成AMD或者英特尔的替代品,就得重新学习、重写代码、重新调试,成本高得吓人,很多人宁愿继续用旧版本,也不愿意费那个劲去折腾。

太原云服务器

阿里云服务器降温

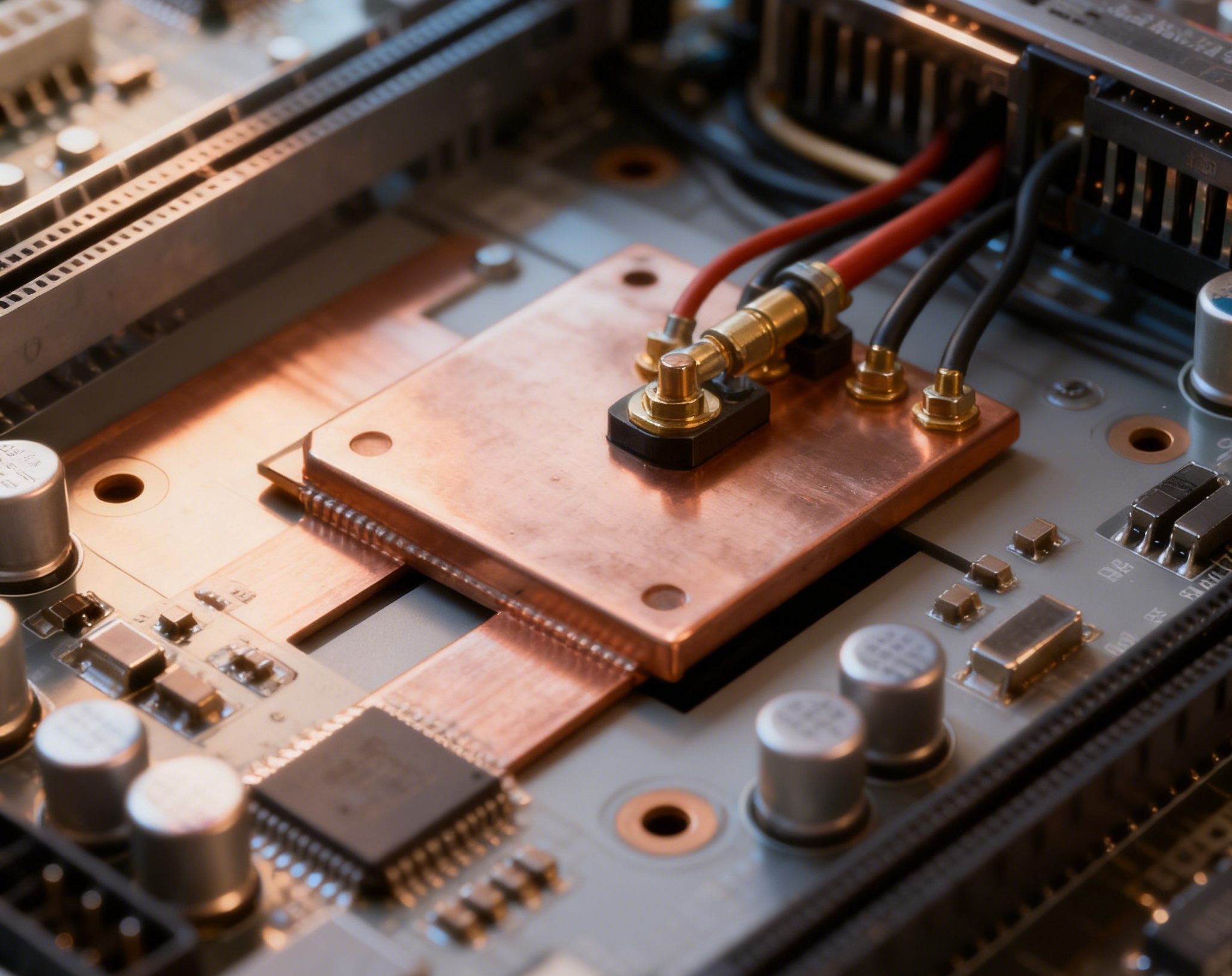

人工智能技术发展起来之后,CUDA 更是找到了最适合自己的舞台,深度学习训练需要大量计算矩阵,而 CUDA 正好特别擅长做这个,像 PyTorch、TensorFlow 这些主流框架,底层都依赖 CUDA 提供支持,英伟达推出的 H100、A100 这类芯片,基本就是为 CUDA 量身打造的,企业选择购买这些硬件,实际上买的是整个生态的稳定性和可持续性。

如今在自动驾驶、数字孪生和云调度这些新兴领域,全都离不开CUDA技术,全球超过九成的AI训练任务都在英伟达的显卡上运行,背后是它十年积累下来的用户习惯与行业标准,虽然别的公司也在推出类似方案,像AMD的ROCm和英特尔的oneAPI,但始终没能动摇CUDA的地位,大家不是不知道有其他选择,而是实在不敢轻易更换。

到2025年底,OpenAI和Meta这些公司还在大量购买H100集群,没人看到有谁大规模转到其他平台上去,这说明不是技术不行,而是生态太牢固了,换个平台就像重新盖房子一样,既花时间又费力气还容易出问题,所以很多人干脆认命,继续跟着CUDA走。

有时候我觉得这事儿就像手机系统,安卓和iOS都挺好用,但你一旦用上了其中一个,装了很多应用,数据也全在里面,再想换到另一个就变得特别麻烦,CUDA也是这样的,它不是靠性能绝对领先,而是因为你已经投入了太多,没法轻易回头,这种软性的绑定,比任何技术上的限制都更管用。

华为云服务器防御

发表评论

最近发表

标签列表